2022年11月末、米OpenAI社が公開したChatGPTは、公開後わずか5日でユーザー数100万人を突破するなど、爆発的に注目を集めました。

ChatGPTが「自然な会話(チャット)ができるAI」であり、「アプリやWebサイト上で誰でも使える」ことはすでに多くの人が知っています。しかし一方で、日々流れてくる情報の更新速度が早く、ChatGPTを説明する上で重要な点を十分に理解できずにいる人も多いのではないでしょうか。

そこでこの記事では、今さら人には聞きづらいChatGPTの基本的な情報と現状での課題、今後予想される展開について解説したいと思います。

目次

◇ChatGPTについての基礎知識

◆ChatGPTとは何か

Webで「ChatGPTとは?」と検索すると、ChatGPTについての説明が記載されたページが数多くヒットします。しかし、説明に用いられている文言はページによって微妙に異なっており、予備知識のない人からすると一体どれが正しい説明なのか、判断が難しいかもしれません。ChatGPTの説明としては、大別すると以下の3つが多く見られます。

・ChatGPTとは、チャットボット(サービス)である

・ChatGPTとは、生成AIの一種である

・ChatGPTとは、LLM(大規模言語モデル)である

これらの説明は、どれも間違いとは言えません。ChatGPTとは「OpenAI社が開発した自然言語処理(NLP)のためのアーキテクチャであるGPT(Generative Pre-trained Transformer)をベースに、テキストチャットに特化したAIモデル」を指す名称です。文脈によって、OpenAIがサイト上で公開しているAIチャットボットを指すこともあれば、GPTファミリーに含まれるモデルの一つとして用いられることもあります。

◆何がすごいのか

ChatGPTが全世界で大きな話題となった背景には、まるで「人間が返信しているのではないか」と思えるほどの回答の自然さにあります。高度なデータ学習に基づく推論能力によって、あたかも会話の文脈やニュアンスを理解して応答しているかのような創造的な文章を生成します。また、プロンプトを工夫することで応答の精度や範囲がある程度コントロールでき、様々なタスクに応用できる点も多くの人の関心を引いた理由です。

さらに、この高度な大規模言語モデルがOpenAIのサイト上で一般公開され、アカウントを作成すれば誰でも無料で使えるという点も、ChatGPTが大きな話題となった一因でしょう。

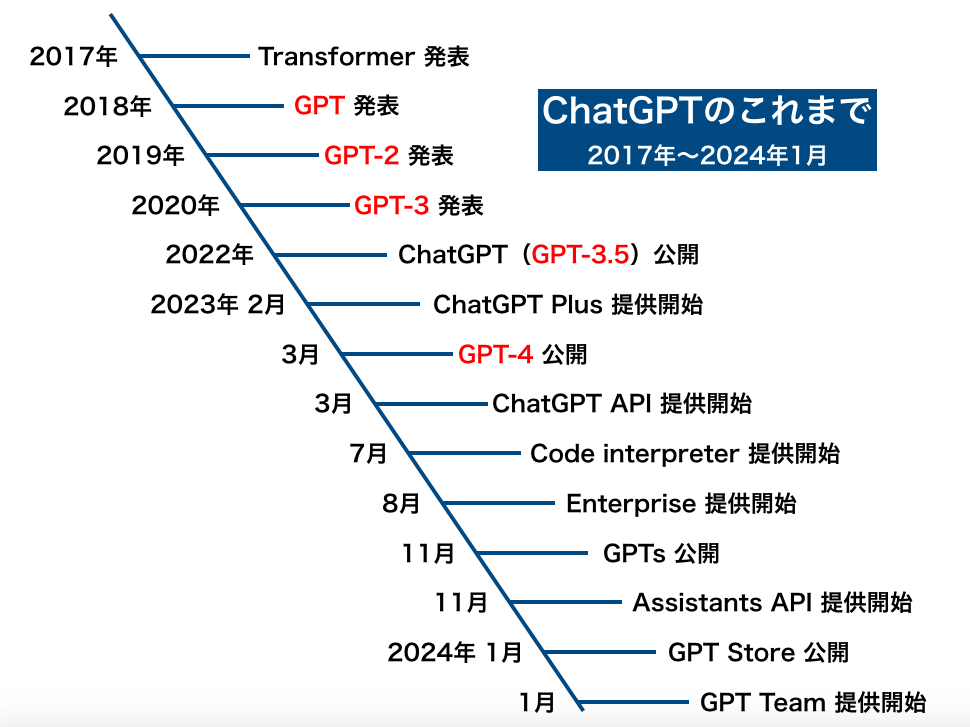

◇GPTモデルの変遷

GPTモデルは時間とともに進化してきました。初代のGPT-1から、GPT-2、GPT-3、GPT-3.5とバージョンが更新され、モデルの複雑さを示すパラメータ数や学習データ量が増加しました。さらにGPT-4ではテキストデータだけでなく画像データを処理できるマルチモーダルアーキテクチャが採用され、さらに幅広い分野で応用可能となりました。

◆GPTのベースとなった「Transformer」

GPTのベースとなっているのは2017年にGoogleの研究者らが発表したTransformerというニューラルネットワーク(人間の脳の仕組みを模した機械学習モデルの一つ)の深層学習モデルです。Transformerは自然言語処理のタスクにおいて特に高い性能を発揮し、これがGPTをはじめとする多くの大規模言語モデルの開発を後押ししました。GPTだけでなくGoogleの「BERT」「PaLM2」といった大規模言語モデルもTransformerをベースとして開発されています。

◆GPTモデルの誕生

Transformerの登場によって、従来よりも大きなデータセットでのトレーニングを高速で行うことが可能となり、それがGPTの開発を推進しました。2018年、OpenAIは”Improving Language Understanding by Generative Pre-Training”という論文の中で初めてGPTを発表。この時点のGPTは7000冊の書籍データを用いてトレーニングされた言語モデルでした。そこからモデルのバージョンアップを繰り返しすごとに学習データ量、パラメータ数が大幅に増加し、飛躍的に性能を向上させてきました。

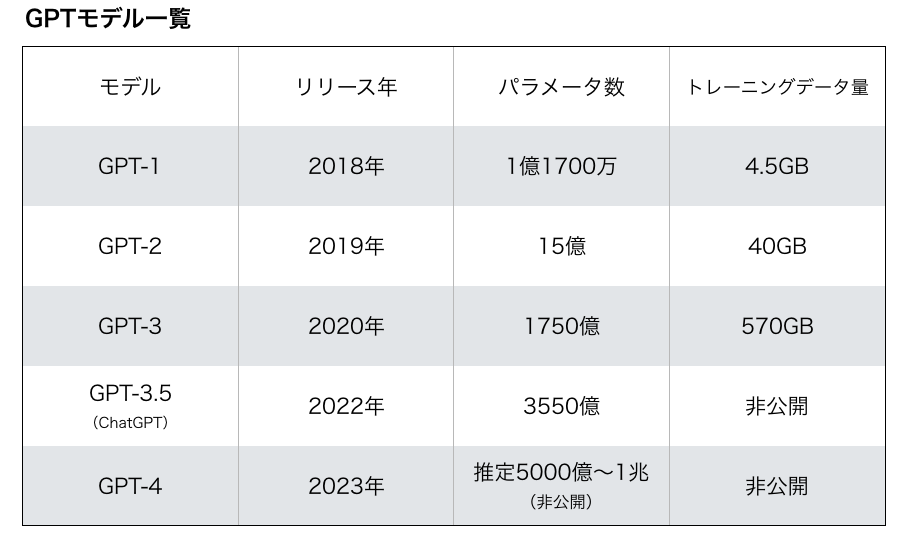

◆ChatGPT公開→GPT4まで

ChatGPTの公開当初、多くの人を驚かせた「まるで人間のような自然な応答」を実現したのは、トレーニング中に処理する必要のある変数の数=パラメータ数です。パラメータ数はすなわちモデルの複雑さを表し、大規模言語モデルはパラメータ数が増えれば増えるほど、性能が向上するとされています。GPTシリーズの性能の進化も、このパラメータ数の推移を見るとよくわかります。

GPTシリーズの最初のモデル、GPT-1のパラメータ数は約1.2億でした。そこからGPTはバージョンアップするごとに飛躍的にパラメータ数が増え、ChatGPT公開当初に搭載されたGPT-3.5のパラメータ数は3550億個とされています。実際は前身であるGPT-3の時点でパラメータ数は1750億個に上り、一般に認知されないまでも、その性能の高さにAI関連業界には激震が走りました。さらに、後継のGPT-4のパラメータ数は推定で5000億〜1兆個とも言われています。

◆マルチモーダルAIへ

GPT-4には、シリーズ初のマルチモーダルAIという特徴もあります。マルチモーダルAIとは、複数の形式のデータを処理可能なAIモデルのこと。GPT-4はそれまでのGPTシリーズとは異なり、テキストデータだけでなく画像データも処理できるモデルとして開発されたのです。

これによりChatGPTの有料プランで利用可能なGPT-4Vは、画像の内容をテキストで説明したり、画像内に含まれる文章を要約・翻訳するといった、より幅広いタスクに対応できるようになりました。

◆提供形態の多様化

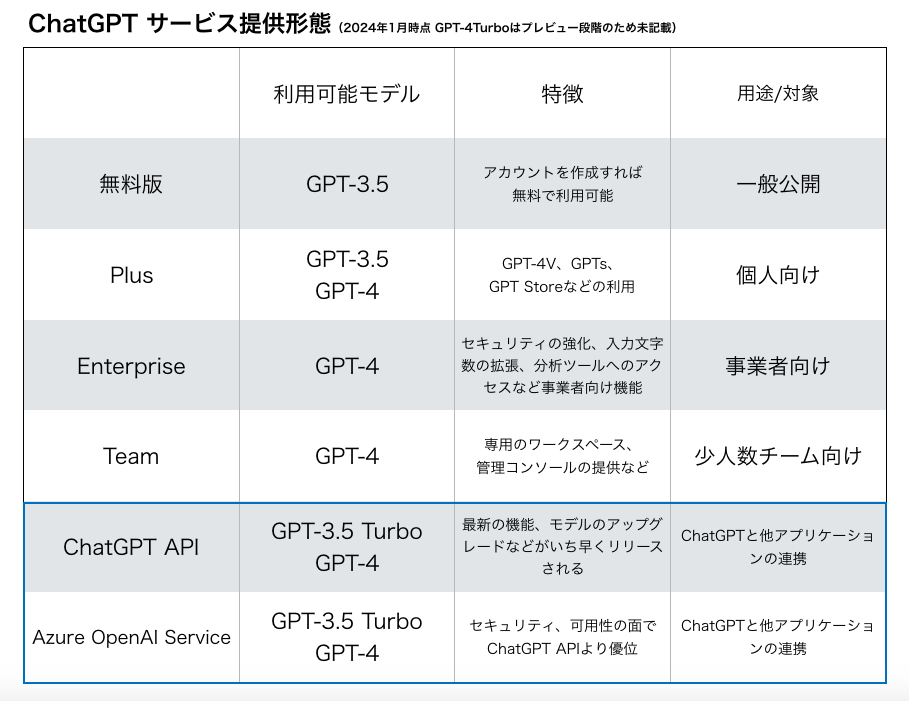

ChatGPTには、複数の提供形態(利用方法)が存在します。

一般に公開されている無料プランの他に、有料で最新モデルや機能などが利用できる「Plus」、事業者向けの「Enterprise」、小規模グループでの利用に適した「Team」といったプランがあります。またOpenAI、MicrosoftからそれぞれAPI(Application Programming Interface)が提供されています。APIを利用することで、ChatGPTの機能を様々なアプリケーションに統合することが可能です。

◇ChatGPTの課題

2023年11月末の公開からわずか1年余りの間に、様々な展開と進化を見せたChatGPT。しかし、ChatGPTには公開当初から指摘され、未だ解決に至っていないいくつかの懸念があります。

◆ハルシネーション(人工知能の幻覚)への対応

ChatGPTは時折、現実に存在しない情報や誤った情報を生成してしまうことがあります。これがハルシネーション(人工知能の幻覚)と呼ばれる問題であり、正確性の向上が求められています。ハルシネーション には大別して以下の2つのパターンがあります。

・学習データに基づいてはいるが、事実と異なる情報を生成してしまう

・学習データにない情報を生成してしまう

ハルシネーションが起こってしまう原因は、学習データそのものの問題や、学習プロセス、アーキテクチャの問題など様々です。あるいは、AIが不完全な情報を推論によって補完することによって起こる場合もあります。いずれも、いまだに絶対的な解決方法が見出されていない問題ですが、ハルシネーションに起因する訴訟なども現実に起こっています。

ハルシネーションについて、詳しくはこちらの記事をご覧ください。

◆データプライバシーの保護、情報漏洩への対策

ChatGPTはモデルの改善のために、ユーザーとの会話データをモデルの再トレーニングに利用する場合があります。その場合、ChatGPTが学習したデータには個人情報や機密性の高いデータが含まれている可能性があるため、これに対してデータプライバシーの保護や安全性の確保が必要です。また、ChatGPTは大量のデータ処理を行うため、クラウドサーバーを経由してデータの送受信を行います。その過程でサイバー攻撃を受けた場合などに、情報が漏洩してしまう懸念もあります。

◆著作権侵害など法的問題への対応

ChatGPTが生成する文章が著作権侵害や法的問題を引き起こす可能性があるため、これに対処するための法的なフレームワークやガイドラインが求められています。ChatGPTはWeb上の大量のテキストデータを使ってトレーニングされており、その中には個人や企業が著作権を持つデータも含まれています。そのデータを基に生成したテキストが著作権(知的財産権)の侵害にあたる可能性があり、実際にOpenAI社は複数の企業からすでに訴訟を起こされています。

◆サイバー犯罪などへの悪用の懸念

ChatGPTの技術が進化すれば、その技術が悪用される懸念もあります。ChatGPTのテキスト生成能力を利用すれば、フィッシング詐欺などのメール文書を大量に作成することができ、しかもターゲットとなる国の言語に合わせて高度な翻訳を同時に行うことが可能です。

また、ChatGPTはプログラムコードを生成できるため、サイバー攻撃などに利用可能な点も指摘されています。セキュリティ製品製造を手掛けるチェック・ポイント・ソフトウェア・テクノロジーズの報告によるとサイバー犯罪者によるChatGPTの悪用は既に始まっており、具体的な事例も公開されています。

◇ChatGPTの今後

登場から現在(2024年1月)に至るまで、凄まじい速度での進歩・展開を見せてきたChatGPTをはじめとする生成AIテクノロジー。今後はさらに幅広い人々にとって身近なツール、サービスとして世の中に浸透していくものと思われます。ただし、生成AIが人類にとって安全で有益な存在として発展していくためには、上述した懸念への技術的な対応や法整備が必要不可欠です。

◆より高度な能力の獲得へ

ChatGPTの進化は現在も続いています。2023年11月7日にOpenAIが開催したカンファレンス「OpenAI DevDay」では、GPTモデルのバージョンアップ(GPT-4 Turbo)に加え、ChatGPTのさらなる発展を示すアップデートが発表されました。

中でも自然言語でAIチャットボットが作成可能な機能「GPTs」、GPTsで構築したボットを他のユーザーに公開、共有できる「GPT Store」、ユーザーの指示に従ってモデルや機能を呼び出してタスクを実行する「Assistants API」の発表は、大きな話題を呼びました。

今後も、ChatGPTは性能のベースアップと同時に、目的・用途に合わせた様々な機能やプランが提供されることになるでしょう。また、「OpenAI DevDay」ではAPI利用の価格引き下げも発表されており、これによりさらに多くの企業がChatGPTのビジネス利用に参入することが予想されます。今後、ChatGPTを使ったサービスやツールはさらに幅広い分野、業界に普及していくでしょう。

◆ChatGPTのライバル

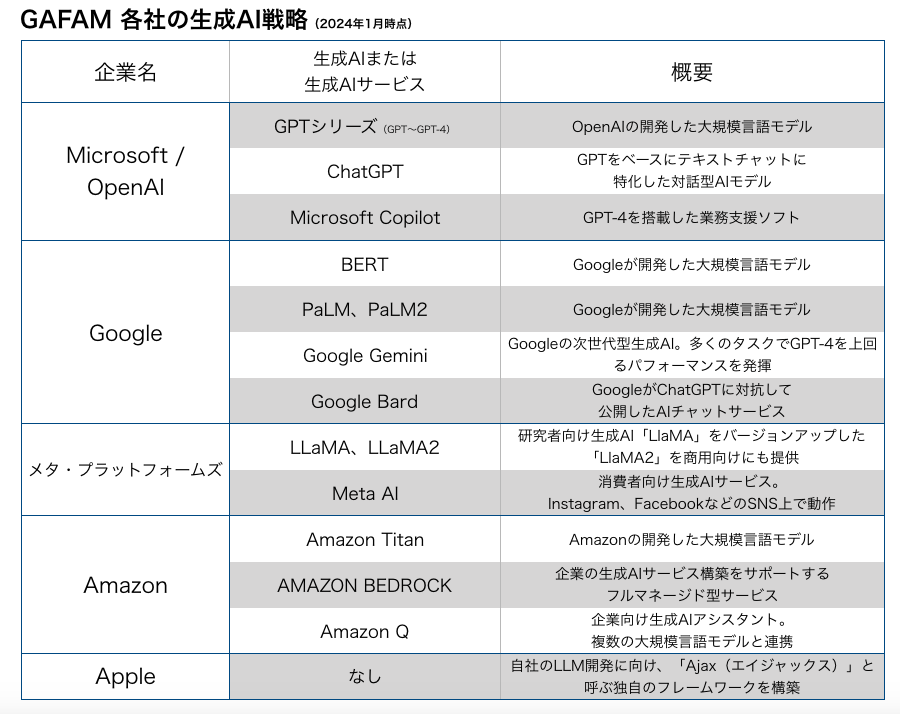

一方で、自然言語処理技術を用いたAIモデルはもちろんChatGPTだけではありません。

Microsoftが提供する検索エンジン「BingAI」にはGPT-4が搭載されており、対話形式でのWeb検索が可能です。また、GoogleがChatGPTの対抗馬として発表したチャットサービス「Google Bard」は、発表当初はChatGPTと比較され評判が芳しくなかったものの、その後アップデートを重ね、2023年12月にBardに搭載された最新のAIモデル「Gemini」は、ほとんどのタスクでGPT-4を上回るパフォーマンスを発揮したとされています。

現時点で一般提供されている生成AIサービスではMicrosoftが大きくリードしているように見えますが、GAFAMと呼ばれる他の巨大ITテック企業もまた独自に生成AI開発を続けています。技術革新の目覚ましいこの分野において、10年後にどの企業が覇権を握っているか、予測は困難を極めます。

◇ChatGPTをビジネスに利用する方法

現在ChatGPTと連携したサービスが数多く登場しており、ChatGPTのビジネス利用が広がっています。今後は、あらゆる業界のビジネスにおいて、ChatGPTに代表される生成AIをいかに使いこなすかがビジネスの明暗を分ける要因になるといっても過言ではありません。

ただし、前述した通りChatGPTには未だ解決されていない課題が存在します。そうした問題点がもたらすリスクを最小限に抑え、ビジネスシーンでの安全で効果的な運用を実現するためには、信頼できるAIサービスを選択することが重要です。

◆ビジネス利用にオススメのChatGPT連携サービス

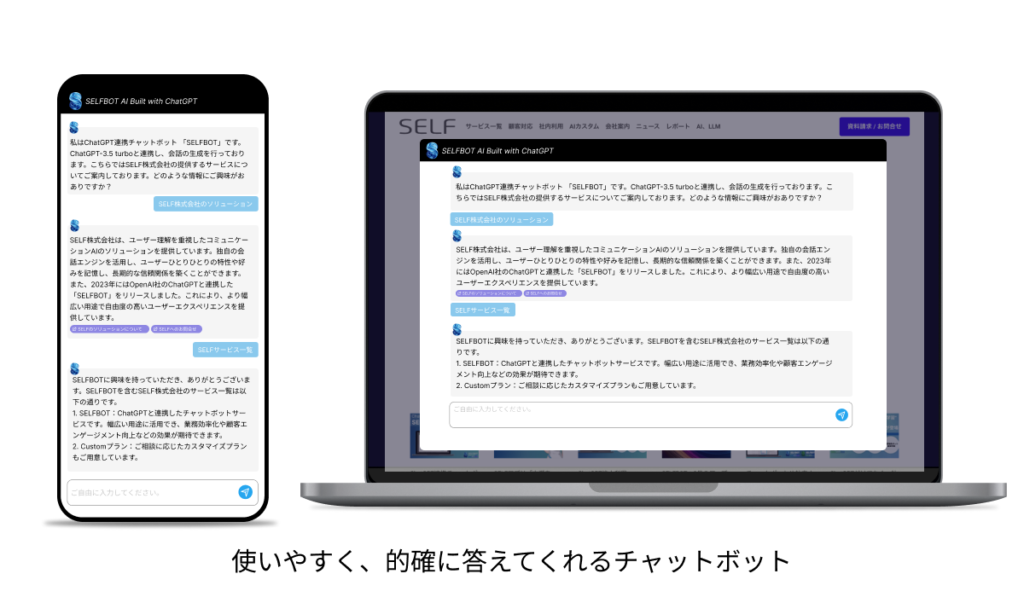

SELF株式会社の提供する「SELFBOT」は、ChatGPTと連携した高度な生成AIチャットボットを安全、かつ手軽に導入・運用できるサービスです。データ学習によって特定の分野に特化したオリジナルのAIチャットボットを即座に構築可能で、Microsoft Azureの利用によりセキュリティ面も万全です。また使いやすさにこだわった管理画面を備えており、ボットの管理・運用も効率的に行えます。

◆無料トライアル実施中

SELFBOTは無料トライアルを実施中です。

SELFBOTによる会話体験を、実際のサービス環境下にてご利用頂けます。WEBサイト上でのカスタマーサポート、社内ナレッジ検索などの用途でお試し頂くことが可能です。詳細は下記のお問い合わせページよりお気軽にお問い合わせください。

SELFのライターを中心に構成されているチーム。対話型エンジン「コミュニケーションAI」の導入によるメリットをはじめ、各業界における弊社サービスの活用事例などを紹介している。その他、SELFで一緒に働いてくれる仲間を随時募集中。