RAGを使った社内AI検索やナレッジ活用は、多くの企業で検討段階から実装段階へ移り始めています。ただし、いま企業が問われているのは『RAGを作れるか』ではなく、『本番運用に耐え得るか』です。

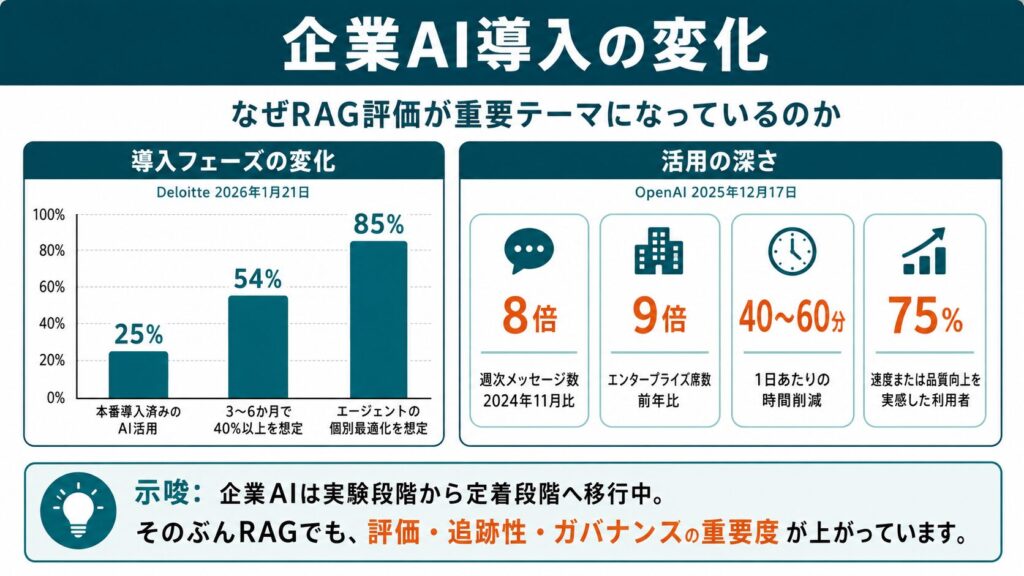

2026年1月公開のDeloitteの調査では、企業のAI活用は実験から本番展開へ移行しつつあり、エージェント活用への期待も高まっています。2025年12月のOpenAIレポートでも、企業内でのAI利用は業務フローへの組み込みが進み、利用の深さが成果の差につながり始めていることが示されました。

その流れの中で注目されているのがRAG評価です。回答が自然かどうかだけでなく、必要な情報を取り出せているか、根拠を示せるか、危険な操作に進まないか、改善を回し続けられるかまで含めて評価する考え方が欠かせません。

この記事では、RAG評価の基本、企業担当者が見るべき指標、AIエージェント時代に追加したい観点、導入前後の運用手順までを実務目線で整理します。

目次

◇ なぜ今、RAG評価が重要なのか

RAGの役割は、生成AIに社内情報や最新情報を安全に参照させることです。ところが、実際の導入では『答えがそれらしく見えるのに根拠が弱い』『必要な文書を見つけられない』『権限をまたいで参照してしまう可能性がある』といった課題が起こります。

最近の市場動向を見ると、これらは一部の先進企業だけの悩みではありません。IBMは2026年3月にOpenRAGを発表し、RAGを閉じた構成で囲い込むのではなく、データ取り込み・検索・推論の各層を運用しやすく制御する重要性を強調しました。Microsoftも2026年4月に、エージェントの権限制御や監視を前提としたガバナンスツールを公開しています。

つまり、RAGは『検索を足した生成AI』から、『業務判断を支える知識基盤』へ位置づけが変わっています。だからこそ、導入時のデモではなく、本番運用を見据えた評価設計が重要です。

◇ RAG評価で見るべき3つのレイヤー

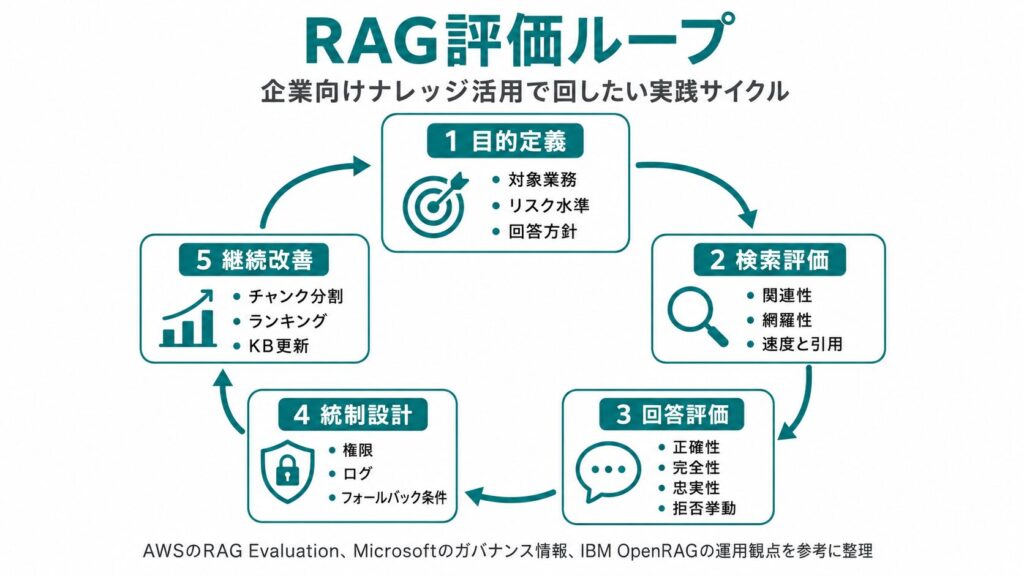

RAG評価は一つの点数で終わりません。少なくとも、検索・回答・運用の3つのレイヤーで分けて確認すると、改善ポイントが見えやすくなります。

1. 検索レイヤーは『必要な情報を取れているか』を見る

最初に見るべきは、生成前の検索品質です。質問に対して関係の薄い文書ばかり出ている場合、どれだけ高性能なモデルを使っても回答品質は安定しません。

確認したい代表指標は、コンテキスト関連性・網羅性・引用の妥当性・検索速度です。AWSが2025年3月に一般提供したRAG Evaluationでも、retrieval側の評価指標としてcontext relevanceやcoverageが重視されています。

企業実務では、FAQのように答えが短い領域と、規程集や提案書のように文脈依存が強い領域では、適切なチャンクサイズやメタデータ設計が変わります。評価では『検索できているか』だけでなく、『その業務に必要な単位で検索できているか』を見てください。

2. 回答レイヤーは『正しいか、足りているか、言い過ぎていないか』を見る

次に、モデルが返す最終回答を評価します。代表的な観点は、正確性・完全性・忠実性・回答拒否の適切さです。忠実性は、取り出した根拠から逸脱していないかを確認する観点で、社内AIでは特に重要です。

たとえば、規程に記載のない例外処理をAIがもっともらしく補ってしまうと、現場では『便利だけれど危ない』状態になります。逆に、曖昧な問いに対しては、不十分な根拠のまま断定せず、追加確認を促す挙動のほうが望ましい場合もあります。

そのため評価では、正答率だけを追うのではなく、誤答時の壊れ方まで見ておく必要があります。

3. 運用レイヤーは『継続的に改善できるか』を見る

本番導入では、一度精度が安定したら終わりではありません。文書が更新される、問い合わせ傾向が変わる、モデルや検索基盤が切り替わると、RAGの品質も変動します。

ここで見るべき指標は、回答あたりのコスト、応答時間、再質問率、有人エスカレーション率、未解決率、評価データの更新頻度などです。OpenAIの2025年企業レポートでは、AI活用が深い企業ほど定型化されたワークフローに埋め込まれている傾向が示されています。RAGも同様に、運用指標と改善ループがあって初めて定着します。

◇ AIエージェント時代のRAG評価で追加したい観点

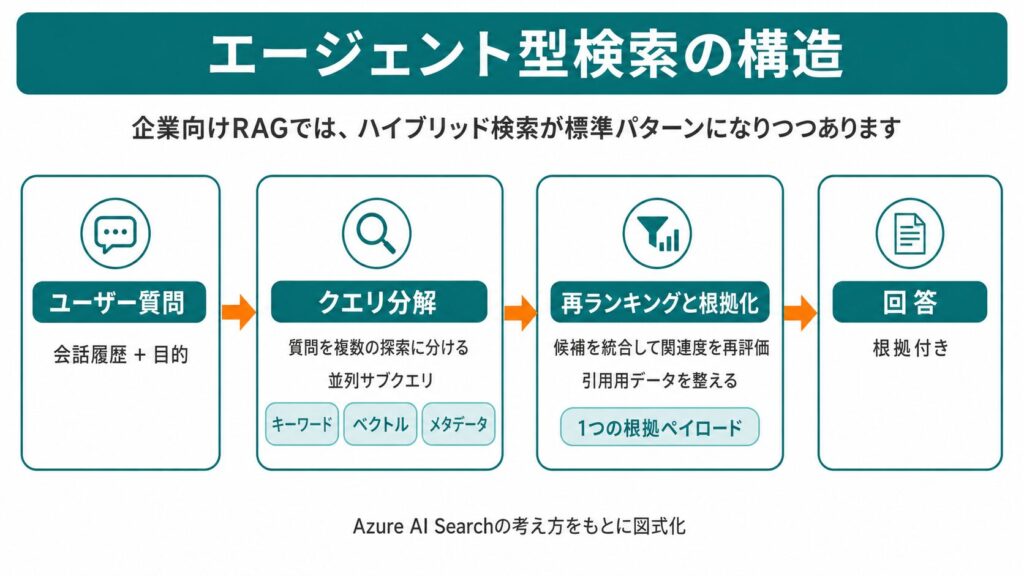

最近は、RAGが単体のQ&Aで終わらず、検索結果をもとに次の操作を行うエージェント型の活用が増えています。この場合、評価対象は回答品質だけでは足りません。

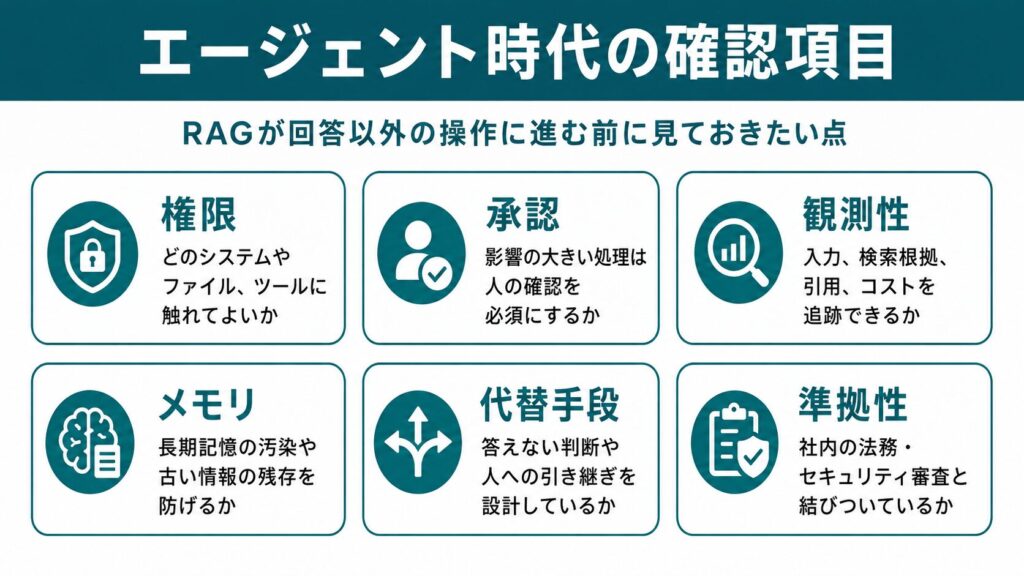

■ 権限とツール利用の境界が明確か

社内ストレージ、SaaS、チケット管理、CRMなどをまたいで動く場合、AIがどこまで参照・操作してよいかを明確にする必要があります。Microsoftが2026年4月に公開したAgent Governance Toolkitでも、ツール誤用や権限逸脱、メモリ汚染などが主要リスクとして整理されています。

RAG評価の段階で、参照だけ許可するのか、下書き生成まで許可するのか、申請登録まで進めるのかを線引きしておくと、本番時の事故を減らせます。

■ ログと観測性が確保されているか

あとから『なぜその回答になったのか』を追えない仕組みは、企業利用では扱いづらくなります。少なくとも、入力文、検索された文書、採用された根拠、最終回答、利用モデル、実行されたツール、失敗時の理由は追える状態にしておきたいところです。

この観測性があると、検索の問題なのか、プロンプトの問題なのか、権限設定の問題なのかを切り分けやすくなります。

■ 失敗時の振る舞いが設計されているか

企業で使われるAIは、常に正解を返す必要はありません。むしろ、根拠が弱いときに無理に答えないこと、確認先を案内すること、人に戻すことのほうが重要な場面があります。

評価時には、正答ケースだけでなく、答えないほうがよいケース、権限外の情報を尋ねられるケース、複数部門の規程がぶつかるケースも含めてテストしておくと安心です。

◇ 企業でRAG評価を進める5つの手順

導入初期に大規模な評価基盤を作る必要はありません。まずは対象業務を絞り、改善が回る単位で始めるのが現実的です。

1. 対象業務を一つに絞る

就業規則、営業提案、ヘルプデスク、製品問い合わせなど、答え合わせしやすい業務から始めます。検索意図が混ざりすぎると、評価軸もぶれやすくなります。

2. 良い回答と悪い回答の基準を先に決める

正確であることだけでなく、引用を含むこと、結論と根拠が対応していること、曖昧な場合は確認を促すことなど、評価の観点を文章で定義します。

3. 検索評価と回答評価を分けて記録する

回答が悪いときに、検索が悪いのか、生成が悪いのかを切り分けられるようにします。ここを分けないと、改善施策が空回りしやすくなります。

4. 本番に近い例外ケースを混ぜる

略語、あいまい表現、古い文書、新旧ルールの混在、権限外の質問など、現場で起こりがちな揺れを早めに入れておくと、導入後の手戻りが減ります。

5. 改善の優先順位を運用指標で決める

すべてを一度に直そうとせず、問い合わせ件数が多いテーマ、誤答の影響が大きいテーマ、改善効果が測りやすいテーマから手を付けます。精度とコスト、速度のバランスを見ながら回すことが重要です。

◇ RAG導入でよくある失敗

よくある失敗の一つは、ベンダー比較やモデル比較に意識が向きすぎて、評価データと運用体制の整備が後回しになることです。これでは、デモでは良く見えても、本番で改善が止まりやすくなります。

もう一つは、社内文書を入れれば自然に賢くなると考えてしまうことです。実際には、文書の鮮度、版管理、権限設計、メタデータ、引用の見せ方など、周辺設計が品質を大きく左右します。

さらに、エージェント型活用を見据えるなら、検索精度だけでなく『どの操作まで自動化してよいか』の合意形成も欠かせません。

◇ まとめ

2026年のAI市場では、企業の関心はPoCの実施そのものから、業務に定着するAI基盤づくりへ移っています。その中でRAG評価は、単なる精度チェックではなく、社内AIを安心して広げるための運用設計そのものになりつつあります。

これからRAGを導入する企業は、回答品質だけでなく、検索品質、ガバナンス、観測性、改善サイクルまでを一体で設計することが重要です。逆に言えば、ここを押さえれば、RAGは単発の実験ではなく、社内ナレッジ活用の基盤として育てやすくなります。

■ 社内AI検索ならSELFBOT

RAGや社内AI検索の導入を検討しているなら、まずは対象業務を一つ決め、評価用の質問セットと判定基準を先に用意するところから始めてみてください。PoCの段階で評価設計まで整えておくと、導入後の改善スピードが大きく変わります。

出典:

AWS, Amazon Bedrock RAG Evaluation GA, March 20 2025

https://aws.amazon.com/about-aws/whats-new/2025/03/amazon-bedrock-rag-evaluation-generally-available/Deloitte, The State of AI in the Enterprise 2026 / press release

https://www.deloitte.com/us/en/about/press-room/state-of-ai-report-2026.htmlOpenAI, The state of enterprise AI, December 17 2025

https://openai.com/business/guides-and-resources/the-state-of-enterprise-ai-2025-report/IBM, OpenRAG announcement, March 10 2026

https://www.ibm.com/new/announcements/coming-soon-to-watsonx-data-turn-unstructured-data-into-context-for-ai-with-openragMicrosoft Open Source, Agent Governance Toolkit, April 2 2026

https://opensource.microsoft.com/blog/2026/04/02/introducing-the-agent-governance-toolkit-open-source-runtime-security-for-ai-agents/Microsoft Azure AI Search, agentic retrieval, May 19 2025

https://techcommunity.microsoft.com/blog/azure-ai-foundry-blog/introducing-agentic-retrieval-in-azure-ai-search/4414677

SELFのライターを中心に構成されているチーム。対話型エンジン「コミュニケーションAI」の導入によるメリットをはじめ、各業界における弊社サービスの活用事例などを紹介している。その他、SELFで一緒に働いてくれる仲間を随時募集中。